Die meisten Anwendungen maschinellen Lernens laufen heutzutage zentralisiert, was bedeutet, dass alle erforderlichen Trainingsdaten in einem einzigen Datenzentrum vorliegen. In der Praxis möchten verschiedene Parteien jedoch oft gemeinsam ein Modell trainieren, ohne den anderen Parteien ihre Daten zur Verfügung stellen zu müssen.

„Zum Beispiel können Gesundheitseinrichtungen keine sensiblen Patientendaten teilen, wollen aber gemeinsam trotzdem Vorhersagemodelle für Diagnosen und Behandlungsempfehlungen entwickeln“, sagt Prof. Dr. Odej Kao, Lehrstuhlinhaber für Verteilte Systeme und Betriebssysteme an der TU Berlin und BIFOLD Fellow.

Dezentrale Organisation

Für solche Anwendungsfälle wurde das sogenannte Federated Learning (verteiltes Lernen) als Alternative zum zentralisierten Training von KI-Systemen entwickelt. Beim Federated Learning werden Modelle dezentral von verschiedenen Partnern trainiert, ohne dass Daten zwischen unterschiedlichen Institutionen übertragen werden müssen.

Wissenschaftler gehen allerdings davon aus, dass die wachsende Nutzung von Federated-Learning-Anwendungen den weltweiten Energieverbrauch des maschinellen Lernens drastisch erhöht. Bereits heute gilt maschinelles Lernen als eine der energieintensivsten Rechenanwendungen. Gerade das Konzept des verteilten Trainings von KI-Modellen in örtlich getrennten Datenzentren bietet neue Chancen, die Ausführung der Rechenanwendungen an die Verfügbarkeit von grüner Energie zu koppeln.

Maschinelles Lernen ohne operative CO2-Emissionen?

BIFOLD-Forscher Philipp Wiesner, Dennis Grinwald, Pratik Agrawal, Lauritz Thamsen, Odej Kao sowie Ramin Khalili vom Huawei Munich Research Center haben genau diese Forschungsfrage untersucht, und demonstrieren, wie Federated Learning ausschließlich mit grüner Energie durchgeführt werden könnte – also ohne zusätzliche CO2-Emissionen zu verursachen.

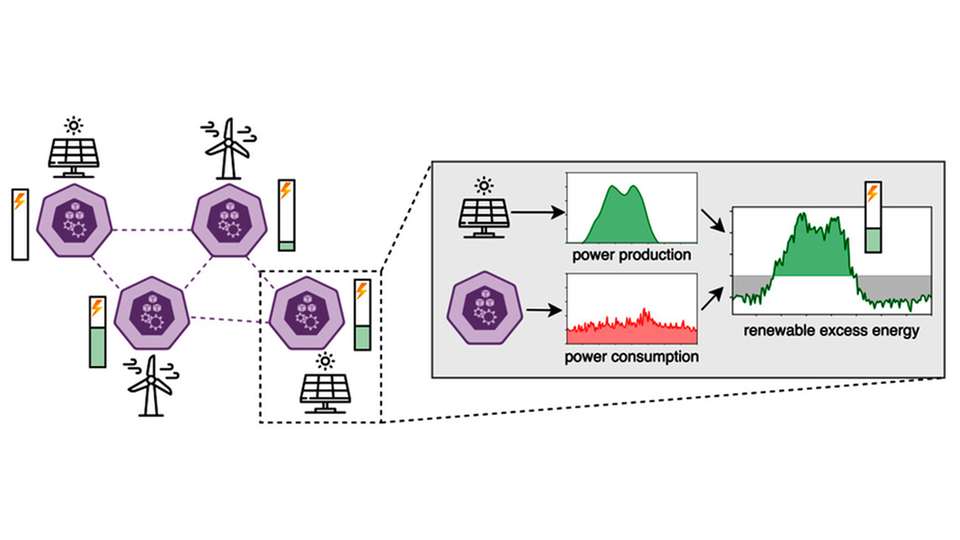

Dafür schlagen sie ein neues System vor, genannt FedZero, das Federated Learning basierend auf der Verfügbarkeit von sogenannter überschüssiger erneuerbarer Energie plant. Überschüssige Energie tritt auf, wenn erneuerbare Quellen wie Sonne oder Wind mehr Strom produzieren als aktuell benötigt wird. FedZero nutzt die überschüssige Energie und koppelt sie an ungenutzte Rechenressourcen. So können die CO2-Emissionen des Trainings effektiv auf null reduziert werden.

Federated-Learning-Projekte, die sich auf die Verwendung von überschüssiger erneuerbarer Energie fokussieren, bringen im Gegenzug jedoch neue Herausforderungen mit sich. „Beim Federated Learning stoßen wir zusätzlich auf das Problem von Fairness: Partner mit sehr wenig Zugang zu überschüssiger grüner Energie könnten im finalen Modell unterrepräsentiert sein, da ihnen auch entsprechend wenig Trainingszeit zur Verfügung steht“, erklärt Wiesner. Um genau diese Verzerrung zu verhindern, passt FedZero das Tempo des Trainings dynamisch an die aktuellen Umstände an und optimiert den Trainingsprozess so, dass alle beteiligten Parteien Trainingszeiten in einem angemessenen Umfang erhalten.